ChatGPT, la Inteligencia Artificial conversacional que podría sustituir a Google

La Inteligencia Artificial (IA) avanza a pasos agigantados. Esta tecnología revolucionaria ha dejado de ser algo futurista, para pasar a convertirse en una realidad muy palpable. Uno de los ejemplos más recientes de la emergencia de estas nuevas capacidades es ChatGPT, una IA de procesamiento de lenguaje natural basado en un modelo por algoritmo llamado GPT-3.

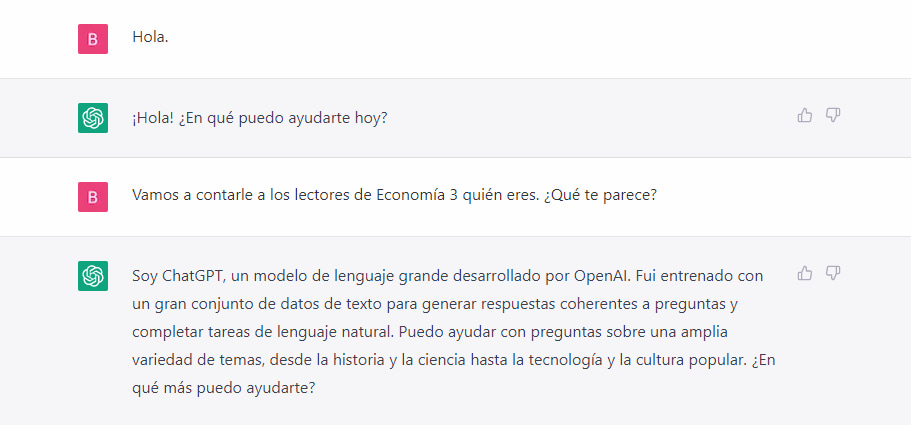

¿Y qué hace ChatGPT? Principalmente, mantener una conversación acerca de cualquier cosa que le preguntes. El algoritmo es capaz de hablar con cualquier persona con la naturalidad con que lo haría un ser humano, gracias a su modelo compuesto por más de 175 millones de parámetros.

Detrás de esta tecnología se encuentra la empresa OpenAI, una firma de investigación tecnológica que nació en 2015 sin ánimo de lucro y que ha ido evolucionando hasta 2019, momento en el que Microsoft invirtió en ella 10.000 millones de dólares.

¿Qué hace ChatGPT tan especial?

El algoritmo aprende a base de parámetros. Cuanta más información recopila, y se alimenta constantemente cada vez que alguien hace uso de él, más precisa se tornará su forma de responder. Este es el punto fuerte de ChatGPT, una inteligencia que ha sido entrenada para ser capaz de entender lo que se le está preguntando y responder de manera coherente.

Enrique Puertas, profesor de Inteligencia Artificial y Big Data en la Universidad Europea de Madrid (UE), va más allá: «Es una tecnología revolucionaria porque estos textos que genera son correctos y naturales desde el punto de vista del lenguaje. Además, pese a que su objetivo inicial no era el de responder preguntas, al haber sido entrenado con miles de millones de textos en muchos idiomas, ha tenido como consecuencia que, aparte de escribir bien, lo que responde es correcto en la mayoría de los casos», asegura.

En la actualidad, el valor de mercado de esta empresa es de 28.000 millones de dólares, explica Pablo Trilles, CEO de la tecnológica AuraQuantic. «Del valor total, 10.000 millones son una inversión de Microsoft para convertirse en el accionista mayoritario. Han visto que el futuro pasa por esta herramienta. Es muy potente para ciertas cosas, se le puede pedir que te escriba un artículo, por ejemplo, y lo hará con una gramática muy buena», explica.

¿Google en peligro?

Puesto que los textos que ha empleado para aprender «a hablar» han sido extraídos de internet, ChatGPT recurre a esta misma información a la hora de responder. Eso hace que, por «accidente», sea capaz de responder a aquello que se le pregunta. Los detractores, sin embargo, esgrimen que su objetivo no es ser correcto y no todo lo que responde es preciso desde el punto de vista de la veracidad de información.

«Tiene todo tipo de aplicaciones comerciales. Se habla de que Microsoft lo quiere incorporar al buscador Bing para hacer la competencia directa a Google. De esta forma cualquier pregunta al buscador podría ser respondida de forma automática. También se habla de que lo quieren integrar en todos los sistemas de Windows 12, de forma que esté integrada en el sistema operativo», asegura el profesor de la UE.

No sólo el buscador de internet por excelencia está en peligro, también lo están, afirman sus detractores, muchos puestos de trabajos cuya producción se pueda automatizar. «Los periodistas, por ejemplo, corren riesgo de ser sustituidos por esta IA», sentencia Puertas.

También las IA creativas de imágenes son capaces de producir ilustraciones en base a unos parámetros determinados; lo que puede ser muy disruptivo y, a su vez, poner en peligro muchos puestos de ilustradores o fotógrafos.

Los peligros de la IA

Pero no todos los aspectos de esta novedosa herramienta son positivos. Además del evidente riesgo de la pérdida de empleos para humanos; la información que nos proporciona no siempre es correcta, ya que su objetivo nunca fue ese.

El peligro de dar por veraces informaciones creadas a partir de la IA y que no lo son, está ahí. Su mal uso también da lugar a ciertos peligros, como la generación maliciosa de fake news, la desinformación o de su uso irregular con fines ilícitos.

«Se corre el riesgo de que la IA no entiende del bien y del mal. Si no se tiene mucho cuidado por parte de la empresa, lo que pasa es que muchas de las cosas que genera pueden ser políticamente incorrectas o incluso ilegales», afirma Puertas.

Y sentencia: «Un ejemplo extremo es que la IA puede defender el holocausto nazi si se le pide. En la actualidad eso se ha corregido, pero como no sabe lo que está bien y lo que está mal, esos riesgos están presentes».

Borja RamírezGraduado en Periodismo por la Universidad de Valencia, está especializado en actualidad internacional y análisis geopolítico por la Universidad Complutense de Madrid. Ha desarrollado su carrera profesional en las ediciones web de cabeceras como Eldiario.es o El País. Desde junio de 2022 es redactor en la edición digital de Economía 3, donde compagina el análisis económico e internacional.

Borja RamírezGraduado en Periodismo por la Universidad de Valencia, está especializado en actualidad internacional y análisis geopolítico por la Universidad Complutense de Madrid. Ha desarrollado su carrera profesional en las ediciones web de cabeceras como Eldiario.es o El País. Desde junio de 2022 es redactor en la edición digital de Economía 3, donde compagina el análisis económico e internacional.